Amazon Web Services 한국 블로그

AWS DeepLens 지금 주문 가능!

AWS DeepLens는 현장에서 디바이스에 직접 딥 러닝 모델을 실행하는 비디오 카메라입니다. 작년에 하드웨어 및 시스템 소프트웨어와 관련하여 상세한 블로그를 게시한 적이 있습니다. 간략히 요약하자면 다음과 같습니다.

AWS DeepLens는 현장에서 디바이스에 직접 딥 러닝 모델을 실행하는 비디오 카메라입니다. 작년에 하드웨어 및 시스템 소프트웨어와 관련하여 상세한 블로그를 게시한 적이 있습니다. 간략히 요약하자면 다음과 같습니다.

하드웨어 – 4메가픽셀 카메라(1080P 비디오), 2D 마이크 배열, 인텔 아톰® 프로세서, 듀얼 밴드 Wi-Fi, USB 및 마이크로 HDMI 포트, 모델 및 코드용 8GB 메모리

소프트웨어 – Ubuntu 16.04, AWS Greengrass Core, 디바이스 최적화 버전의 MXNet 및 인텔® clDNN 라이브러리, 기타 Deep Learning 프레임워크 지원

이번 AWS re:Invent에서 참가자들은 즉각적이고도 만족스러운 반응을 보였습니다. 교육자, 학생 및 개발자가 실습 세션에 등록하여 바로 그 자리에서 모델을 구축하고 훈련하기 시작했습니다. 미리 보기 기간의 열기는 AWS 서밋 세션까지 이어졌고 AWS는 참가자가 흥미로운 모든 이벤트를 즐길 수 있도록 디바이스, 도구 및 훈련에 대한 액세스를 제공하는 등 최선을 다했습니다.

Hackathon과 Challenge

AWS는 지난 달 HackTillDawn에서 참가자에게 DeepLens 디바이스를 사용할 수 있는 기회를 제공했습니다. 다행히 저도 이벤트에 참여하여 세 명의 우승자를 선정하는 데 도움을 줄 수 있었습니다. 팀을 보는 내내 놀라움을 감출 수 없었습니다. 기계 학습 또는 컴퓨터 비전 경험이 전무한 대부분의 팀이 대규모 뮤직 페스티벌에서 참가자의 경험을 향상하도록 설계된 흥미롭고 정교한 애플리케이션을 구축하기 시작했기 때문입니다. 세 명의 우승자는 EDC Vegas에서 경쟁을 벌였고 거기서 최우수상(Find Your Totem)을 받을 팀이 선정되었습니다. 우승 팀에 축하 인사를 전하며 EDC Orlando에서 좋은 시간을 보내시길 바랍니다.

AWS DeepLens Challenge도 시행되었습니다. 이 Challenge에서 참가자는 DeepLens를 활용하는 Machine Learning 프로젝트를 구축해야 하며 Amazon SageMaker 및/또는 AWS Lambda를 사용할 경우 보너스 포인트를 받을 수 있습니다. 아동, 성인 및 동물을 위해 설계된 애플리케이션을 비롯하여 다양하고 흥미로운 애플리케이션이 제출되었습니다. 데모 비디오 및 소스 코드를 포함하는 모든 제출물에 대한 세부 정보를 커뮤니티 프로젝트 페이지에서 확인할 수 있습니다. 세 개의 우승 애플리케이션은 ReadToMe(1위), Dee(2위) 및 SafeHaven(3위)입니다.

DeepLens는 그 자체로 탁월한 학습 도구라는 사실을 검증 받았습니다. HackTillDawn 참가자들과 이야기를 나누면서 기술 역량을 넓히고 경력을 발전하는 데 도움이 될 실습 경험을 간절히 원하는 참가자가 많다는 것을 알게 되었습니다.

미리 보기 업데이트

미리 보기 기간에 DeepLens 팀은 한시도 쉬지 않고 디바이스 기능을 개선하는 데 열중했습니다. 중요한 추가 사항은 다음과 같습니다.

Gluon 지원 – Gluon(MXNet에 대한 필수 인터페이스)을 사용하여 컴퓨터 비전 모델을 구축하고 훈련한 다음 DeepLens로 가져와 배포할 수 있습니다.

SageMaker 가져오기 – Amazon SageMaker에서 모델을 구축하고 훈련한 다음 DeepLens로 가져올 수 있습니다.

Model Optimizer – 디바이스에서 실행되는 이 Optimizer는 다운로드된 MXNet 모델을 최적화하여 DeepLens GPU에서 효율적으로 실행될 수 있도록 합니다.

지금 구매 가능

지금 DeepLens가 판매 중에 있으며 Amazon.com에서 주문할 수 있습니다. 이제 며칠 내에 고유한 딥 러닝 애플리케이션을 직접 구축할 수 있습니다. 디바이스는 미국 내 주소로 배송 가능하며 추가 도착지를 논의 중에 있습니다.

또한 초기 기능 세트를 보완하는 몇 가지 중요하고 새로운 기능을 추가하고 있습니다.

프레임워크 지원 확대 – 이제 DeepLens가 TensorFlow 및 Caffe 프레임워크를 지원합니다.

MXNet 계층 지원 확대 – 이제 DeepLens가 Deconvolution, L2Normalization, 및 LRN 계층(MXNet 제공)을 지원합니다.

Kinesis Video Streams – DeepLens 카메라의 비디오 스트림을 Amazon Kinesis Video Streams와 함께 사용할 수 있습니다. 원시 카메라 피드를 클라우드로 스트리밍한 다음 Amazon Rekognition Video를 사용하여 비디오에서 객체, 얼굴 및 콘텐츠를 추출할 수 있습니다.

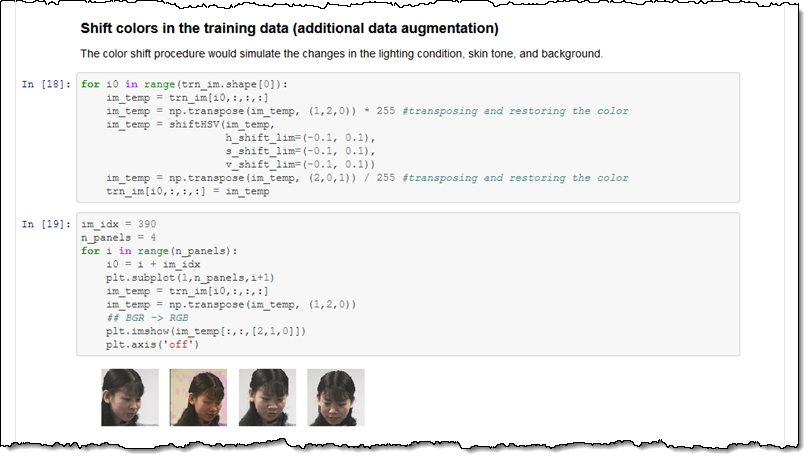

새로운 샘플 프로젝트 – 이제 DeepLens에 얼굴 위치 감지(TensorFlow 기반)를 위한 샘플 프로젝트가 포함됩니다. 이 샘플을 검토하여 모델의 구조를 확인해 볼 수 있습니다. 다음은 Notebook에서 발췌한 내용입니다.

여러분이 자체 DeepLens를 사용하여 구축하는 애플리케이션을 하루 빨리 보고 싶습니다. 결과가 나오면 꼭 알려 주십시오!

— Jeff